adrianrohnfelder

Moderators

-

Benutzer seit

-

Letzter Besuch

Alle Inhalte von adrianrohnfelder

-

Wie AI Imaging das Foto-Business verändern wird (Video)

Auf den Punkt gebracht @Zauberfrau, dem ist nichts hinzuzufügen 👍🏻

-

Vorstellungs-Thread

Hallo und herzlich Willkommen und meines Wissens geht das auch nur so, also über den exakten Link.

-

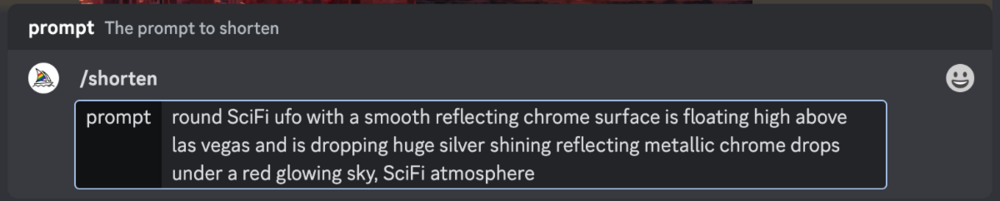

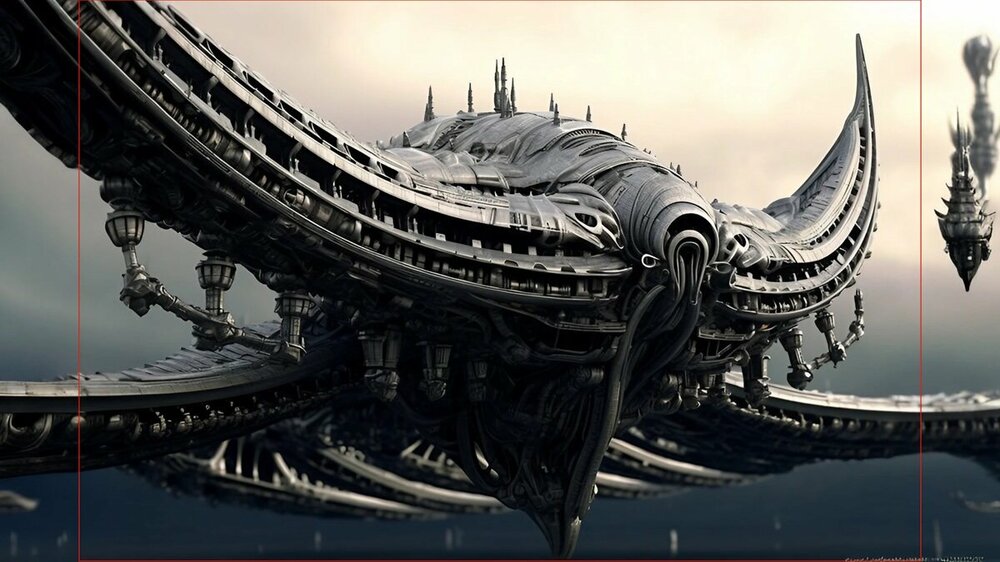

Midjourney Prompt analysieren mit /shorten

Mit dem /shorten Befehl könnt Ihr von Midjourney Euren Prompt analysieren lassen. Ihr bekommt dann angezeigt, welche Teile Eures Prompts und zu welcher Gewichtung von Midjourney verwendet werden bzw. welche Wörter überhaupt keine Rolle spielen. Damit könnt Ihr anschließend entweder wesentliche Begriffe gewichten oder es mit einer anderen Reihenfolge und alternativen Begriffen probieren. Aber von Anfang an. Gebt den Befehl /shorten und anschließend den zu analysierenden Prompt ein. Als Ergebnis erhaltet Ihr eine Information über die für Midjourney relevanten Token (Prompt Begriffe) sowie die Begriffe, welche überhaupt keine Berücksichtigung finden. Zudem noch fünf immer weiter gekürzte Versionen Eures Prompts, welche Ihr Euch auch gleich generieren lassen könntet: Wenn Ihr nun auf Show Details unten klickt wird es richtig interessant. Damit wirft Euch Midjourney nämlich aus, mit welcher Gewichtung jeder einzelne Bestandteil Eures Prompts gewertet wird. In meinem Fall habe ich das für eine Bildidee eines Raumschiffes gemacht, welches große silberne Tropfen über Las Vegas abwirft. Die Analyse hat dabei u.a. ergeben, dass der Begriff is dropping (wirft ab) überhaupt keine Berücksichtigung findet. Daher habe ich den Prompt ein wenig umgestellt und umformuliert mit dem Begriff drops are falling und erneut durch /shorten analysieren lassen mit dem Ergebnis, dass falling berücksichtigt wird. Ich habe den Prompt dann einmal generieren lassen, mit einem passablen Ergebnis. Nur waren mir die Tropfen ein wenig zu klein. Ich wusste durch die Analyse aber zumindest, dass der Begriff huge verwendet wird und habe es daher als nächstes mit einer höheren Gewichtung versucht. Dieses Vorgehen fasst den /shorten Befehl schon gut zusammen: Der Befehl versteht keine Gewichtungen oder Parameter, nur einzelne Promptbestandteile Der Befehl optimiert keine Prompts, sondern gibt Euch 'nur' eine Analyse Ihr erhaltet auch keine Alternativvorschläge, die müsst Ihr Euch anschließend auf Basis der Analyse selbst überlegen und ausprobieren Ihr erhaltet also keinen perfekten Prompt als Ergebnis, aber eine sehr hilfreiche Detailanalyse Eures Prompts als Basis für eigene Optimierungen - welche Ihr natürlich auch gleich wieder analysieren lassen könnt.

-

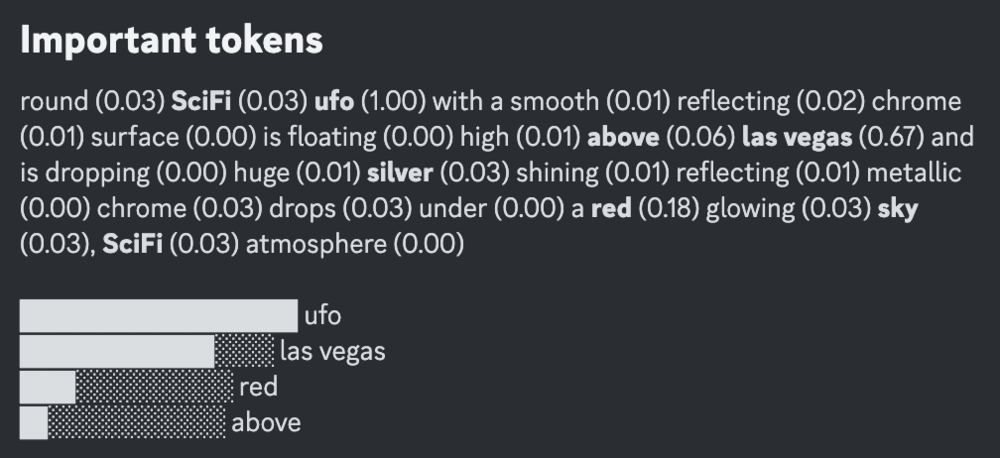

Midjourney --video Parameter: Video Eurer Bildgenerierung

Den --video Parameter gab es bis Midjourney v3, wurde dann aber leider erst einmal ad acta gelegt. Seit dieser Woche funktioniert er wieder mit den v5 Versionen (inkl. dem Outpainting/ Zoom Out😞 Gebt einem Prompt den Parameter --video mit. Wenn Ihr anschließend auf die von Midjourney generierte 4er Auswahl mit dem Briefumschlag reagiert, erhaltet Ihr vom Midjourney Bot eine DM (direct message) mit einem Video der Generierung dieser 4er Auswahl. Das funktioniert auch mit einem Zoom Out, anscheinend aber nicht mit einzelnen Bildern. Wisst Ihr dazu vielleicht etwas? mjvideo.mp4

-

Midjourney V5.2: Outpainting, mehr Variationen, erklärte Prompts mit /shorten

Und noch mehr Neuigkeiten (auch hier folgt die Übersetzung): 1) Now testing /turbo mode Typing /turbo mode makes your images up to 4x faster for 2x the price Excellent for group settings or if you're just in a rush Pricing may change as we update this in the future with faster speeds This is using a experimental GPU pool so if it runs out we may disable it or create temporary limitations Turbo mode only works with fast hours 2) New "MEGA" Membership Plan This is a 120/mo$ tier with 60/hr/month of fast-hours If you buy tons of fast-hours (beyond a Pro plan) it's 2x cheaper to have a MEGA plan (or 2.5x with yearly plan) The MEGA tier lets you run in /turbo mode all the time and still have the same amount of usage as Pro 3) Experimental --weird command This command makes your images look more weird / edgy Do not consider this a stable feature, what's weird may change over time It goes from --weird 0 to --weird 1000 (actually 3000 but idk if you need it that weird) The strength of this command is dynamic with the prompt (you may need to adjust it prompt-to-prompt) We recommend starting with smaller values such as 250 or 500 and then go up/down from there If you want it to look weird AND pretty you should try using --stylize along with your weird If you use --stylize with weird we recommend using a equal value for both parameters Combining --weird with --seed is a bit messed up right now, make sure you set --weird 0 if you want to do comparisons

-

Midjourney V5.2: Outpainting, mehr Variationen, erklärte Prompts mit /shorten

Weitere News von Midjourney, Übersetzung folgt... New Quality of Life Improvements There's a new Imagine All button for /describe jobs that renders all 4 descriptions at once There are new args for --fast and --relax so you can set specific jobs to fast or relax mode without having to use /relax or /fast --seed should now be consistent between fast/relax mode --video should work now for V5 and niji5 models (including outpaints) (das habe ich gleich einmal hier getestet) Quick Notes about V5.2 We're seeing a lot of people have a hard time porting V5.0/V5.1 prompts to V5.2 if they're using high --stylize values. If you used --stylize in V4/V5.0/V5.1 you may need to re-adjust your numbers for V5.2, Try reducing it by much as 5x. Meaning --stylize 1000 V5/V5.1 should be a --stylize 200 prompt for V5.2 Custom Zoom (under all upscales) lets you actually 'change' your prompt for the zoomout, this means you can change the enviroment completely when you zoom and it's pretty cool, try it out!

-

Midjourney Zoom Out zur Erstellung von einem Bild in mehreren Schritten nutzen

Das neue Zoom Out von Midjourney taugt auch dazu, gewünschte Bilder in mehreren Stufen zu erstellen. Bei der Variante Zoom Out 2x und Zoom Out 1.5x wird immer wieder der originale Prompt genutzt. Das führt z.B. bei einem Raumschiff dazu, dass bei mehreren Zoom Outs immer wieder ein größeres Raumschiff dazu kommt. Mit Custom Zoom habt Ihr jedoch die Möglichkeit, dem Zoom Out einen neuen Prompt hinzuzufügen und somit das Outpainting für eine Erweiterung des Motivs zu nutzen: Prompt Bild 1: Death Valley, Badwater Bassin, Salt desert, sunset, red glowing clouds, epic wide angle Custom Zoom Out Prompt Bild 2: A poster of Death Valley with metallic frame on a livingroom wall above some pot plants

-

Vergleich Upscaling Programme für KI generierte Bilder

Ein (noch) großer Nachteil der text-to-image Generatoren wie Midjourney, Stable Diffusion oder Dall-E ist die maximale Auflösung von 1024px. Für das Web ist das ausreichend, für meine Multivisionen oder einen Druck jedoch definitiv nicht. Abhilfe bieten hier sogenannte Upscaler an, also Programme welche die generierten Bilder (die Upscaler funktionieren natürlich auch mit Fotos) auf eine bis zu 8fache Auflösung hochrechnen können, natürlich unter dem Einsatz von KI. Mittlerweile gibt es bereits eine ganze Flut an Upscalern, von kostenlos bis ziemlich teuer, von online über Smartphone bis zu Desktop App. Ich selbst habe bisher noch keine ausführlichen Tests durchgeführt, werde das aber selbstverständlich nachholen. Allerdings habe ich schon diverse Test- sowie Erfahrungsberichte gelesen. Folgende Programme wurden dabei immer wieder positiv erwähnt: Topaz Gigapixel AI sowie auch ON1 Resize AI (beide Programme sind gut getestet, kosten jedoch mehr als 100 Euro) HitPaw Photo Enhancer (öfters gut getestet, kostet 40 Euro, gibt es als Mac wie auch Win App) VanceAI Image Upscaler (online sowie als Desktop App, kostenpflichtig) Let’s Enhance (online, kostenpflichtig) Image Upscaler (kostenlos, online, von der Firma hinter Stable Diffusion) Upscale Media (online, Smartphone App, kostenlos, wird von @Mechagozilla genutzt) Photoshop (hier gibt es ein Plugin SuperZoom, da habe ich aber eher negative Kritiken gelesen) Bigjpg (online, Desktop App, gibt es als kostenlose sowie -pflichtige Version) Upscayl (Desktop App, kostenlos, sehr häufig empfohlen) Spontan würde ich nachdem was ich gelesen und gehört habe zu Upscale Media oder Upscayl greifen bzw. werde die demnächst als erstes testen. Habt Ihr bereits mit dem einen oder anderen Programm gearbeitet? Falls ja, wie sind Eure Erfahrungen? Kennt Ihr evtl. noch weitere brauchbare Alternativen?

-

Midjourney v5.2 Zoom Out (Outpainting)

Ich habe einmal ein paar Zoom Out vom Zoom Out des Zoom Out zusammengebaut (mit FotoMagico am Mac). Die neue Outpainting Funktion in Midjourney v5.2, hat Potential 😍Generierung von Bildern in mehreren Stufen genutzt werden. KI_ZoomOutk.mov

-

Midjourney V5.2: Outpainting, mehr Variationen, erklärte Prompts mit /shorten

So, gleich einmal einem ersten Test unterzogen: Die Qualität der Bilder ist der von v5.1 sehr ähnlich. Das wiederbelebte --stylize habe ich noch nicht getestet. Der Unterschied zwischen High und Low Variation ist deutlich, wobei sich mir im Moment noch nicht der Vorteil der Low Variante erschließt. Evtl. erst mit High eine große Auswahl erstellen und dann mit Low ähnlichere Bilder zu dieser Variante bekommen. Unter einem per U vergrößerten Bild habt Ihr jetzt auch noch die Möglichkeit per Vary (Strong) und Vary (Subtle) weitere Variationen zu erstellen. Der neue Befehl /shorten analysiert Euren Prompt, sehr spannend. Was mir sehr gut gefällt ist das neue Zoom Out (man kann zwischen 2x, 1.5x, Custom und Square wählen) = Outpainting.. Es funktioniert sogar ein Zoom Out vom Zoom Out. Einzige Einschränkung, die Auflösung bleibt gleich. Das mehrfach erweiterte Bild hat die gleiche (geringe) Auflösung wie das Ursprungsbild - dazu werde ich aber demnächst was zu dem Thema Upscaler schreiben.

-

Outpainting Vergleich zwischen Uncrop (Stable Diffusion) und Adobe Photoshop

Und schon getestet 🙂 also das Zoom Out in Midjourney v5.2. Sehr cool! Es geht sogar Outpainting vom Outpainting - einzige Einschränkung, die Bilder werden nicht größer, es bleibt bei der geringen Auflösung, alle drei Bilder hier haben die gleiche Auflösung 😞 PS: Demnächst werde ich ein paar Upscaling Tools vorstellen.

-

Outpainting Vergleich zwischen Uncrop (Stable Diffusion) und Adobe Photoshop

Für mich ist Lightroom DIE Software zum verwalten von Bildern, insofern habe ich kein Problem mit Adobe. Kann aber verstehen, dass nicht jeder so denkt. Insofern ist es super, dass jetzt ja auch Midjourney ein Outpainting anbietet.

-

Outpainting Vergleich zwischen Uncrop (Stable Diffusion) und Adobe Photoshop

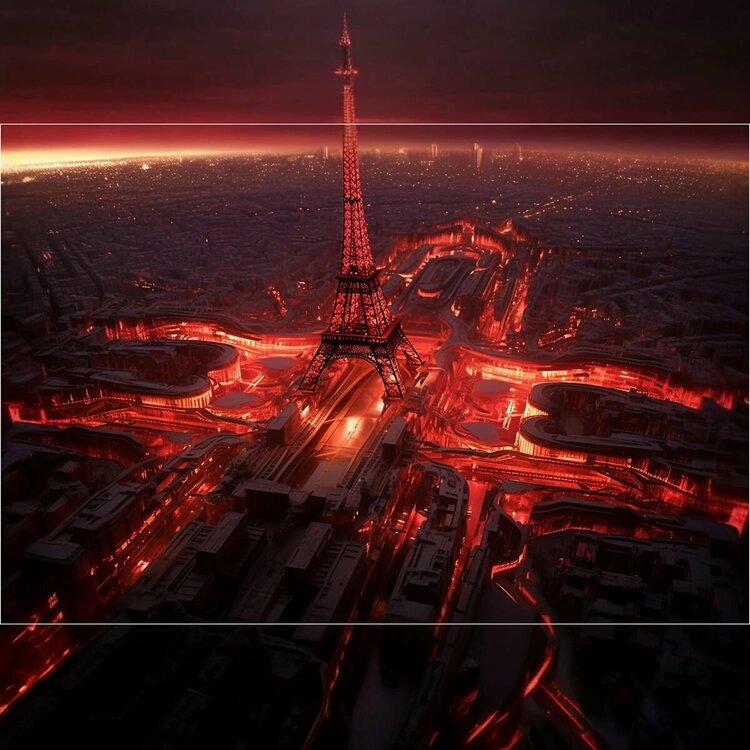

stability.ai, die Firma hinter dem text-to-image Generator Stable Diffusion hat ein neues Tool, Uncrop zum sogenannten Outpainting veröffentlicht. Unter Outpainting versteht man die Erweiterung eines Fotos/ KI-Bildes nach außen. Die gleiche Funktionalität bietet auch das generative Füllen (Generative Fill) von Adobe Photoshop. Ich habe beide Tools ausprobiert und verglichen. Der Vorteil von Uncrop ist, dass es im Browser arbeitet, kostenlos ist und per One-Click funktioniert. Allerdings ist man auf die Formate Hoch, Quer oder Quadrat mit einer maximalen Seitenlänge von 1024px limitiert (wobei es sich gleich per Image upscaler der gleichen Firma vergrößern lässt). Für mich persönlich ist diese Limitierung auf festgelegte Formate ein ziemlicher Nachteil. Zudem sind die Ergebnisse für meinen Geschmack deutlich schlechter als die der Adobe Photoshop Beta. Dort ist man dafür auf die Adobe Cloud bzw. ein kostenpflichtiges Abo angewiesen. Zudem funktioniert das Outpainting hier nicht per 1-Click, sondern benötigt zwei - allerdings sehr einfache - Schritte. Ansonsten haben mich die Variabilität und Qualität der Photoshop Ergebnisse mehr als überzeugt. Die Rahmen bei den Beispielbildern zeigen übrigens das originale KI-Bild. Habt Ihr Uncrop schon einmal ausprobiert? Photoshop Uncrop Photoshop Uncrop Photoshop Uncrop

-

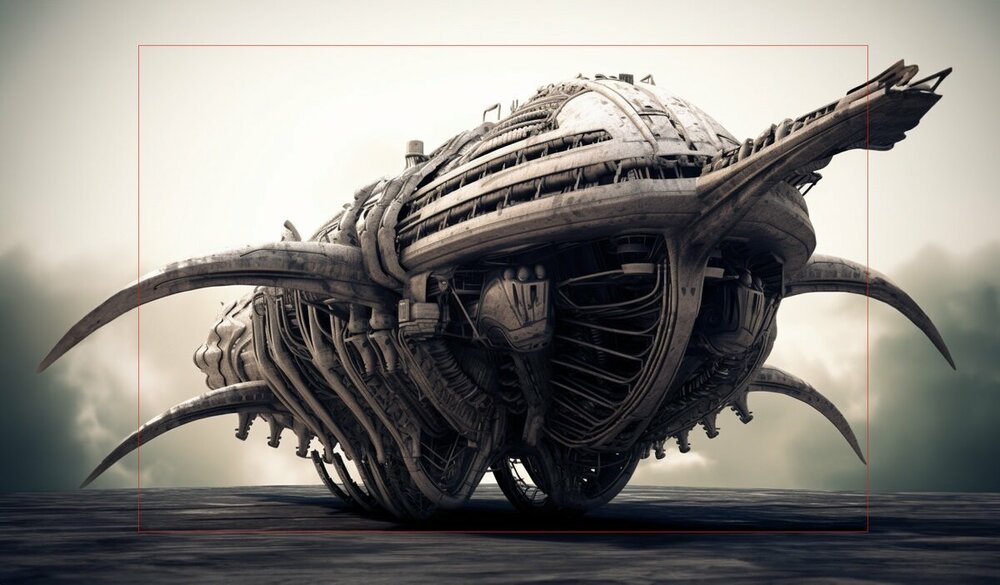

Tipp der Woche: Cooles SciFi Zeugs mit Leonardo generiert

Der User @Mattes hat in Leonardo sowie mit Adobe Photoshop Generative Fill ein paar klasse Science-Fiction Szenen gerendert, Prompt inklusive.

-

Science-Fiction aus Leonardo

Super, danke, mache ich am Dienstag!

-

Science-Fiction aus Leonardo

Hättest Du auch einen Prompt für die ersten Bilder? Dann packe ich es gerne mal in den/das "Prompt & Bild der Woche".

-

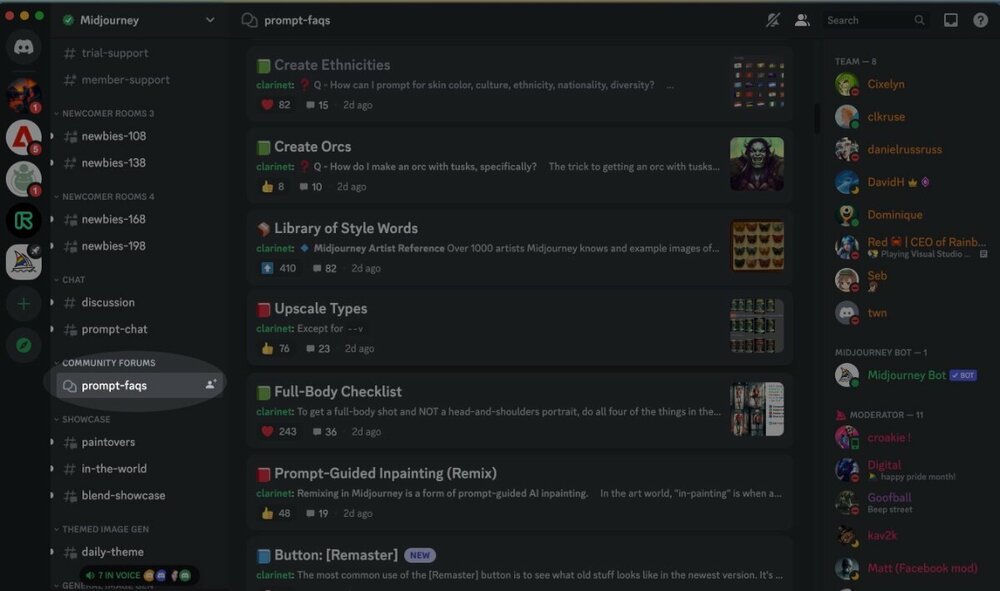

Tipp: Prompt FAQ

-

Science-Fiction aus Leonardo

Coole Stimmung. Und die Erweiterung von KI-Bildern per Photoshop finde ich auch genial! Leonardo basiert auf Stable Diffusion, richtig? Das mit den trainierten Modellen muss ich mir unbedingt mal in Ruhe reinziehen.

-

Ausprobiert: Photoshop Beta mit Firefly "Generative Fill" bzw. "Generative Füllung"

Yep, das ist echt unglaublich wie gut insbesondere das Erweitern von Fotos funktioniert, der rote Rahmen zeigt das originale Bild.

-

Chat GPT Plugin Photorealistic für Midjourney Prompts

Chat GPT Plus Mitglieder können seit einiger Zeit Plugins in Chat GPT hinzufügen und aktivieren. Damit werden quasi aktuelle Suchergebnisse anderer Websites eingebunden, heißt man kann sich z.B. in Chat GPT Flüge der Suchmaschine Kayak ausgeben lassen. Oder eben Midjourney Prompts. Ausführliches Tutorial folgt, hier erst mal in Kürze eine quick&dirty Anleitung: In Chat GPT einloggen und über die drei Punkte unten links neben dem eigenen Usernamen in den Settings die Plugins aktivieren. Anschließend findet Ihr auf der Hauptseite unter Chat GPT 4 (rechts neben dem Button Chat GPT 3.5) ein Dropdown Menü über welches Ihr in den Plugin Store kommt. Dort findet Ihr dann auch das Plugin "Photorealistic". Einfach laden und installieren und schon bekommt Ihr bei der Eingabe von z.B. Write a prompt for a text-to-image generator for a photorealistic full body fire spewing dragon with a correct dragon physiognomy zwei alternative Midjourney Prompts ausgeworfen wie z.B. Picture a dragon, a creature of immense power and beauty, standing tall and proud. Its body is covered in scales that gleam like polished metal, each one meticulously detailed. Flames dance from its mouth, casting a warm, flickering light on its form. The dragon's wings are unfurled, revealing their full span and the intricate network of bones and membranes that give them structure. The style should be ultra-realistic, with a focus on the dragon's correct physiognomy. The lighting should be dramatic, emphasizing the dragon's form and the play of light on its scales. The image should be composed using a telephoto lens, capturing the dragon in all its grandeur. Render the image in high-resolution 16k for a breathtakingly detailed portrayal. --ar 16:9 --v 5.1 --style raw --q 2 --s 750 Natürlich könnt Ihr den Prompt jetzt noch nach Euren Wünschen abändern bzw. werde ich das noch ausführlich testen, also im Sinne von ich prompte selber und vergleiche mit dem Plugin-Prompt. Kennt Ihr das Plugin, habt Ihr es eventuell schon genutzt oder habt Ihr noch Empfehlungen für alternative Prompt Plugins?

-

Adobe Photoshop Beta installieren

Um die neuen KI-Möglichkeiten Generatives Füllen bzw. Erweitern (Generative Fill) in Adobe Photoshop auszuprobieren müsst Ihr Euch im Moment noch die Photoshop Beta-Version installieren. Das ist aber zum Glück ein Kinderspiel 🙂 Ihr öffnet Eure Adobe Creative Cloud Desktop App und findet dort auf der linken Seite den Menüpunkt Beta Applikationen. Wenn Ihr auf dieses Menü klickt, werden Euch alle Beta-Versionen von Adobe angezeigt. Dort installiert Ihr einfach die Photoshop Beta und schon könnt Ihr diese öffnen und parallel zu der 'normalen' Version nutzen - heißt Eure Fotos erweitern bzw. ergänzen lassen.

-

Mitmachspass am Wochenende: Funko Pop Figuren :-)

@Mitschörni Klasse!

-

Text einbringen

Eine Möglichkeit wäre es zudem, dass Du Dir jeweils ein Graffiti für jeden einzelnen Buchstaben generieren lässt, das sollte funktionieren. Und dann alle Buchstaben in z.B. Photoshop zu einem Graffiti zusammenbaust. Dazu nutzt Du am besten bei jedem Bild den gleichen --seed. Aber klar, ist deutlich aufwendiger.

-

Motionleap App (von Lightricks) zum Animieren von Fotos

Die neue Version von Motionleap (App für Apple bzw. Android) kann nun auch KI Bilder generieren. Das habe ich allerdings noch nicht ausprobiert, da das nur in der kostenpflichten Pro-Version möglich ist. Dafür experimentiere ich gerade fleißig mit den Möglichkeiten, Bilder/ Fotos zu animieren wie hier einen mit Midjourney generierten Vulkanausbruch. Weitere Animation inkl. Tutorial folgen... MJ_Vulkan.mov

-

Photoshop Generative Fill: Bilder und Fotos erweitern

Mit dem neuen "Generative Fill" in Adobe Photoshop - bisher nur in der Beta zu nutzen, wie man die Beta findet und seinen Fotos Elemente hinzufügt habe ich bereits erklärt - ist es auch möglich, Bilder zu erweitern. Das klappt sensationell gut, daher schreibe ich Euch hier einmal kurz auf wie das funktioniert (Screenshots folgen): Wähle in der Symbolleiste das Werkzeug Zuschneidenaus. An den Kanten Eures Fotos wird ein Freistellungsrahmen angezeigt. Zieht einen der Eck-/ Kantengriffe nach außen, um die Arbeitsfläche zu erweitern und bestätigt die Erweiterung mit der Eingabetaste oder dem Bestätigungshäkchen in der Optionsleiste. Standardmäßig wird erst einmal für die zusätzliche Arbeitsfläche die Hintergrundfarbe verwendet. Mit dem rechteckigen Auswahlrechteck markiert Ihr nun die zusätzliche Arbeitsfläche. Wählt dabei am besten auch noch einen kleinen Bereich des originalen Bildes aus. Dabei taucht eine kontextbezogene Taskleiste auf mit dem Begriff Generative Fill. Klickt auf Generative Fill, lasst das Textfeld frei und startet die Erweiterung über Generieren. Photoshop füllt nun die leere Fläche auf Basis der Umgebung aus und erweitert somit per KI und auf gefühlt magische Weise Euer Foto. Links und rechts erweitert sowie um SciFi-Elemente per Generative Fill ergänzt (und kaputt gemacht 🙂 ) Original

_055d65.png)

_ee1da0.png)