adrianrohnfelder

Moderators

-

Benutzer seit

-

Letzter Besuch

Alle Inhalte von adrianrohnfelder

-

Stability Matrix - ein automatischer Stable Diffusion Installer

Kennt Ihr schon Stability Matrix? Das ist eine kostenlose Desktop-App, welche die Installation von Stable Diffusion Web UIs wie Automatic1111, Comfy UI, VoltaML, InvokeAI und weitere vereinfacht:

-

Erste Schritte mit Leonardo AI

ich werde demnächst dazu etwas auf Deutsch verfassen, bis dahin erhaltet Ihr einen guten ersten Einblick bzw. ein kurzes erstes Tutorial in Leonardo AI auf Englisch hier: https://www.makeuseof.com/how-to-use-leonardo-ai-create-art/ Im Rahmen eines Tests, welchen ich gerade für das FotoMAGAZIN durchführe, ist Leonardo AI aus meiner Sicht eine echte Alternative zu Midjourney, insbesondere für diejenigen, welche sich nicht mit einer direkten Stable Diffusion Installation beschäftigen möchten.

-

Stable Diffusion kann auch auf Apple Rechnern installiert werden

Ich selber habe es noch nicht ausprobiert, aber anscheinend gibt es mittlerweile auch eine native Stable Diffusion Version für Apple. Hat irgendwer hier irgendwelche Erfahrungen dazu oder damit? https://analyticsindiamag.com/now-you-can-run-stable-diffusion-on-apple-silicon/

-

Science-Fiction aus Leonardo

Ist cooles Zeug dabei 👍🏻 Jetzt noch mit Runway animieren 😉 Generierst Du Deine Lieblingsmotive eigentlich ab und zu mal wieder neu mit neueren Versionen?

-

Die selbe Schlange in verschiedenen Situationen generieren.

Hallo Sascha, konsistente Bilder sind für KI Bildgeneratoren (noch) eine schwierige Sache. Ich habe gestern hier im Tipp der Woche ein Tutorial zu konsistenten Charakteren in Midjourney veröffentlicht. Ansonsten taugt dafür am besten Stable Diffusion, weil Du Dir dort eigene Modelle (also die Schlange) erstellen kannst und diese dann für weitere Bilder nutzen kannst. Allerdings ist Stable Diffusion auch der komplexeste Bildgenerator. Einen guten Überblick darüber kannst Du Dir hier verschaffen: https://urban-base.net/2023/03/stable-diffusion-der-ultimative-guide-fuer-anfaenger/ Du kannst auf Stable Diffusion auch über Leonardo.AI zugreifen und dort meine ich sogar auch eigene Modelle trainieren. Habe ich allerdings noch nicht gemacht, evtl. hat @Mattes Erfahrungen damit? Die Bildqualität von Stable Diffusion/ Leonardo ist aus meiner Sicht zusammen mit Midjourney auf jeden Fall die beste, welche es aktuell am Markt gibt.

-

Tipp der Woche: Charakter Konsistenz in Midjourney

Eine häufig gestellte Frage ist, wie man in Midjourney einen Charakter konsistent über mehrere Bilder generieren kann. @dazzle hat dazu die Tage ein klasse Video (auf Englisch) ausgegraben, welches ich hier gerne noch einmal in den Tipps der Woche verlinke:

-

Tutorial Midjourney Inpainting per Vary Region

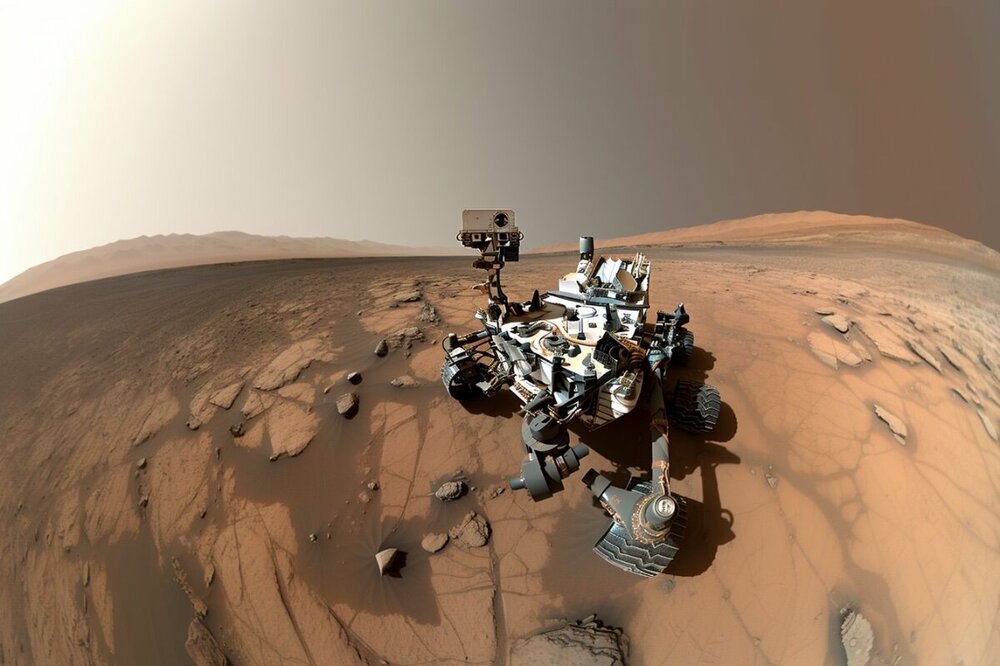

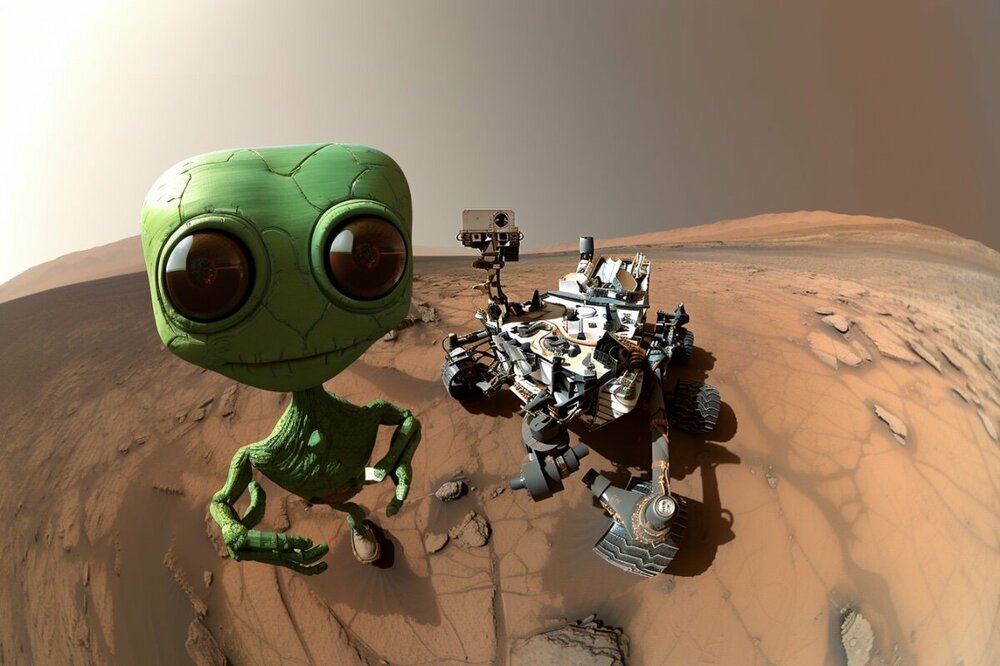

Vor wenigen Tagen hat Midjourney das lang angekündigte Inpainting veröffentlicht, in Midjourney Vary (Region) genannt. Inpainting bedeutet, dass Ihr per Prompt einen frei auswählbaren Bereich eines Bildes nachträglich noch verändern könnt. Allerdings ist diese Funktion im Moment noch ziemlich limitiert. Midjourney selbst empfiehlt, dass sie am besten mit einem recht großen Bereich sowie einem zu dem ursprünglichen Prompt ähnlichen Prompt funktioniert - was ich nach einigen Tests und vielen Fehlversuchen bestätigen kann. Ihr findet die Funktion jeweils unter einem per Upscale (U1 bis U4) generiertem Bild und zwar neben den Funktionen Vary (Strong) und Vary (Subtle). Ganz wichtig! Damit Ihr die Funktion nutzen könnt müsst Ihr vorher via /remix den Remix-Modus aktivieren (dieser Modus dient ursprünglich dazu, dass Ihr einer Variation (V1 bis V4) einen geänderten Prompt mitgeben könnt). Selbsterklärend könnt Ihr dann die Funktion aufrufen, entweder per Auswahlbox oder -lasso einen Bereich auswählen, Euren Prompt eingeben und dann das Bild in vier Varianten generieren lassen. Ich habe mir zuerst ein Selfie eines Mars-Rovers erstellen lassen, dieses dann 1.5fach vergrößert (Outpainting bzw. Zoom-Out) und dann noch das Selfie eines Marsmännchens "geinpaintet". Funktioniert, aber so wirklich dolle finde ich das Ergebnis noch nicht. wide angle selfie of a NASA Mars rover --ar 3:2 --style raw Inpainting: wide angle full body selfie of a small green alien standing on mars Frage 1: Habt Ihr das selbst schon einmal ausprobiert? Frage 2: Ist die Anleitung verständlich oder hättet Ihr lieber noch ein paar Screenshots?

-

Ein Fix für die auf 1024 px limitierte Generative Fill Auflösung

- Großes Update bei Leonardo.AI

Das Feuer in der Feuerschale ist auch echt gut! Überhaupt das ganze Licht. Hast Du mal den Prompt für mich, dann würde ich den spaßeshalber mal durch Midjourney jagen.- Großes Update bei Leonardo.AI

Und noch etwas anderes. Die T-Rex Arme passen noch nicht, da braucht es aber auch bei Midjourney häufig mehrere Versuche.- KI Videotrailer mit ChatGPT, Midjourney und Runway Gen2

Hier findet Ihr (auf Englisch, sorry) ein sehr gutes Beispiel, wie man mit relativ einfachen Mitteln und den Programmen ChatGPT, Midjourney und Runway Gen2 einen kompletten KI Videoclip produzieren kann: https://www.geeky-gadgets.com/make-ai-videos/ Ich selbst werde mich definitiv damit beschäftigen und dann natürlich auch hier die Ergebnisse präsentieren. Habt Ihr Euch schon an so etwas versucht?- Großes Update bei Leonardo.AI

Zweiter Versuch mit PhotoReal/ Alchemy - wobei hier der "blue" Hase ignoriert wurde. Witziger weise wurde das "blue" auch von Midjourney ignoriert, die anderen Generatoren (Firefly, DreamStudio, Bing) haben den Hasen wie gewünscht blau gefärbt.- Großes Update bei Leonardo.AI

Beispiel-Prompt: wide angle photo of a blue rabbit eating a slice of salami pizza on a beach of a mountain lake during sunset Erster Versuch mit Prompt Magic 3 und SDXL 0.9- Großes Update bei Leonardo.AI

Ich teste gerade das neue PhotoReal bzw. Alchemy Beta von Leonardo im Rahmen eines Vergleichs mehrerer Bildgeneratoren (Bilder folgen). Prompt Magic hat bei mir bei meinen Testmotiven nicht so gute Bilder geliefert, aber PhotoReal/ Alchemy ist mindestens gleichwertig (bis auf die Physiognomie eines T-Rex 🙂 ) zu Midjourney. Hast Du @Mattes damit schon einmal gespielt?- Großes Update bei Leonardo.AI

In der Tat sehr beeindruckend. Braucht sich nicht wirklich hinter Midjourney zu verstecken.- Ausprobiert: Photoshop Beta mit Firefly "Generative Fill" bzw. "Generative Füllung"

Coole Bilder und Story. Und genau dafür mag ich KI. Um Bilder und Geschichten im Kopf umzusetzen, welche man warum auch immer nicht (rein) fotografisch umsetzen kann.- Tipp der Woche: In Midjourney nacheinander Pan, Zoom Out, Strong Variation nutzen

Leider habe ich gerade nicht viel Zeit, daher verlinke ich hier nur kurz auf einen sehr interessanten Thread in dem in mehreren Beispielen gezeigt wird, wie man in Midjourney aus einer Kombination der Funktionen Pan, Zoom Out, Strong Variation und weiteren Bilder umsetzen kann, welche in einem einzigen Prompt einfach nicht funktionieren wollen.- Tipp: Kombination von Pan und Zoom Out für Bilder mit mehreren Motiven

Danke, klingt nach einer weiteren guten Idee falls man mal nicht weiterkommt. Also Pan und/oder Zoom und/oder Strong (mit Remix), ggfs. wie weiter oben geschrieben dann ein solches Ergebnis als Basis bzw. Vorlage für einen Prompt nehmen. Ich packe das gleich mal unter den Prompt Tipp der Woche 🙂- Tipp: Kombination von Pan und Zoom Out für Bilder mit mehreren Motiven

Mit strong Variationen habe ich noch gar nicht gespielt, gute Idee!- Pika Labs Video KI

Es hat einen neuen Player im Text-to-Video Bereich, und zwar Pika Labs. Aktuell noch in der Beta Phase und funktioniert wie Midjourney über Discord. Wie auch bei Runway kann man eigene Bilder als Vorlage hochladen. Ein erster kurzer Test hat schon einmal ganz nette Ergebnisse ergeben bzw. hält sich Pika Labs deutlich mehr an die Vorlagebilder denn Runway, cool! @Andreas J. wir brauchen dringend mal einen Video KI Bereich 😉 alien_creature_breathing_fire_from_mouth_--ar_16_9_seed13651498508118429792.mp4 erupting_volcano_with_lava_flows_--ar_16_9_seed4161867794678843019.mp4 steampunk_spaceship_is_landing_on_an_exoplanet_with_a_young_explorer_watching_--ar_16_9_seed7822655243687567481.mp4- Tipp: Kombination von Pan und Zoom Out für Bilder mit mehreren Motiven

Cool, das mit dem Paddel könnte demnächst mit Inpainting gehen, das wäre in der Tat noch einmal eine deutliche Verbesserung. Zudem muss die "dunkle Seite" von Zoom Out und Pan definitiv noch gelöst werden. Ich habe es da auch schon mit bright lighting oder --no dark versucht, ohne Erfolg. Du zeigst mit Deinem Beispiel aber sehr schön, was aktuell schon in der Kombi mehrerer Methoden möglich ist - und, dass auch KI Bilder zu generieren am Ende Arbeit und nicht nur ein simple Texteingabe ist.- Wie lasse ich Midjourney goldene Zähne erstellen, bzw Grillz??

Ich habe auch noch etwas probiert mit ähnlichen Ergebnissen. Jetzt sogar mal mit nem Rappernamen wie von mir oben vorgeschlagen. Nix, null, niente, nada. Schwierig.- Midjourney v5.2 Zoom Out (Outpainting)

That would be great. Tested myself with --no black, --no dark without any effects 😬- Meta hat mit CM3Leon ein eigenes Text-to-Image Modell vorgestellt

Demnächst wird auch Meta (Facebook, Instagram) einen eigenen Text-to-Image Generator anbieten. Genannt wird er CM3Leon (ausgesprochen wie das englische "chameleon") und soll nach eigenen Angaben den anderen Generatoren überlegen sein - aber das versprechen ja irgendwie immer alle 😉 Ein Zeitpunkt der Veröffentlichung wurde noch nicht genannt. Hier geht es zu dem (Englischsprachigen) Blogeintrag von Meta.- Wie lasse ich Midjourney goldene Zähne erstellen, bzw Grillz??

Die in den Mund zu bekommen scheint in der Tat sehr tricky zu sein. Ich kenne mich in der Szene nicht aus, gibt es vielleicht einen bekannten Rapper mit prägnanten Grillz? Falls ja könntest Du dessen Namen mal in Deinen Prompt mit einbauen. - Großes Update bei Leonardo.AI

_055d65.png)

_ee1da0.png)